Содержание

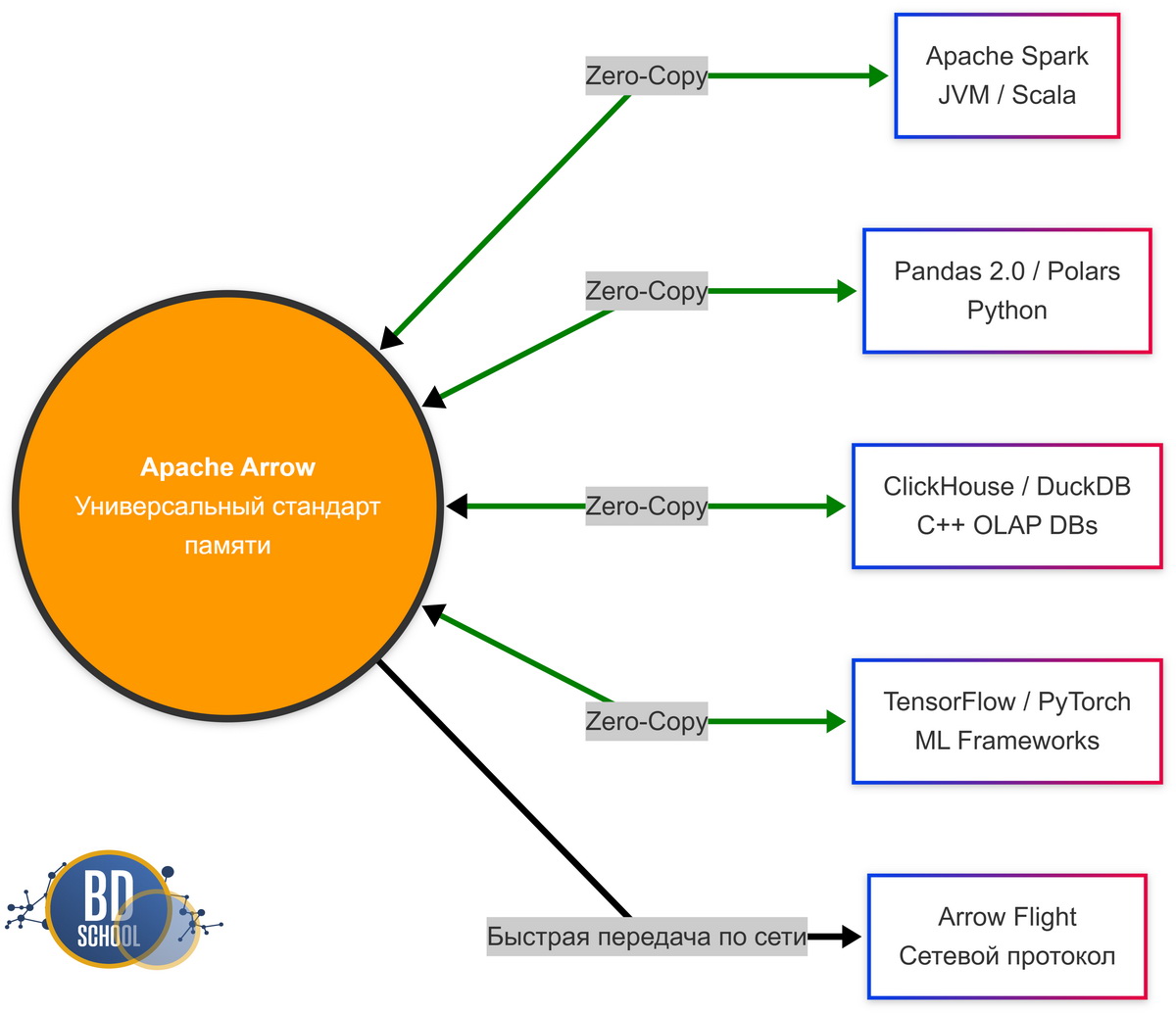

Apache Arrow — это открытый стандарт колоночного представления данных в памяти (In-Memory), предназначенный для высокопроизводительного обмена и обработки данных между различными системами и языками программирования без необходимости копирования или сериализации. Если говорить проще, это универсальный «формат-посредник», который позволяет разным системам (Python, R, Java, C++, Rust) обмениваться данными мгновенно, без затрат на их упаковку и распаковку.

Для современного Data Engineer или Data Scientist это не просто очередная библиотека. Это фундамент, на котором строятся самые быстрые инструменты аналитики: от Pandas 2.0 и Polars до Apache Spark и ClickHouse. Arrow решает главную проблему больших данных — «бутылочное горлышко» при их перемещении между процессами.

Почему старые методы медленные?

До появления Apache Arrow экосистема Big Data напоминала строительство Вавилонской башни. Каждый инструмент хранил данные в оперативной памяти по-своему. Python использовал свои объекты, Java (Hadoop/Spark) — свои, а C++ — свои. Чтобы передать таблицу из Spark в Python-скрипт, приходилось выполнять тяжелую работу.

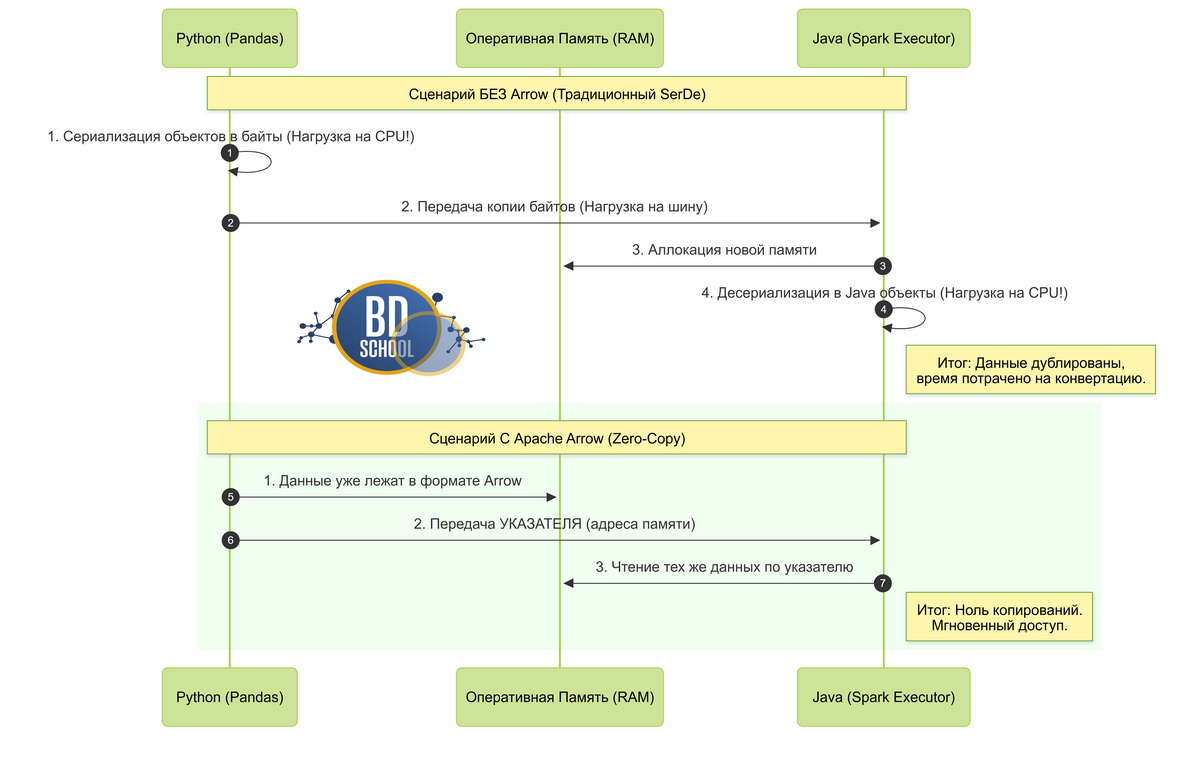

Традиционный процесс обмена данными включает два ресурсоемких этапа:

- Сериализация (Serialization): Система-отправитель конвертирует свои объекты данных в поток байтов.

- Десериализация (Deserialization): Система-получатель читает эти байты и воссоздает объекты в своем формате памяти.

Этот процесс (SerDe) «съедает» колоссальное количество ресурсов процессора. В некоторых сценариях на конвертацию уходит до 80% времени выполнения задачи, в то время как полезные вычисления занимают лишь 20%.

Кроме того, существовала проблема сложности интеграции $O(n^2)$. Если у вас есть 5 языков программирования, вам нужно написать конвертеры для каждой пары (Python-Java, R-C++ и т.д.). Arrow устраняет этот хаос, предлагая единый стандарт физического размещения данных в памяти.

Архитектура Apache Arrow

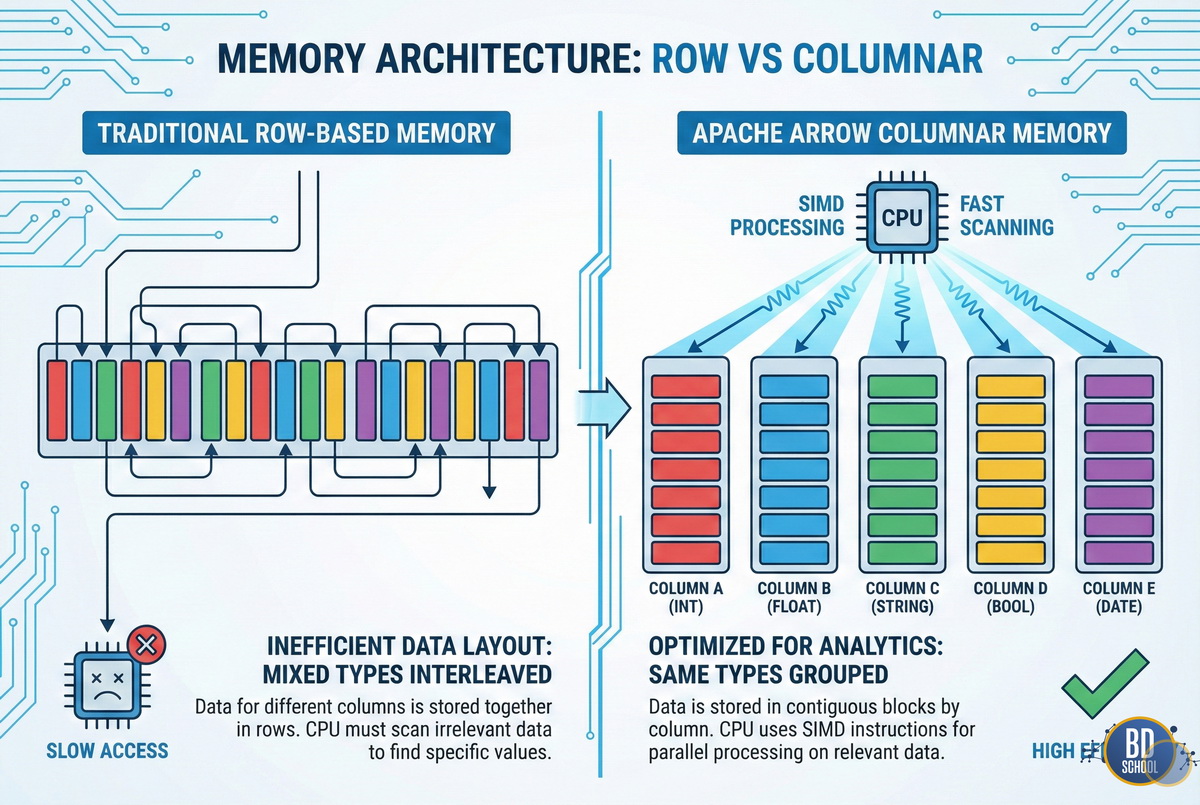

Главная фишка Arrow — это колоночный формат в памяти (In-Memory Columnar Format). Чтобы понять его суть, нужно сравнить его с классическим подходом.

Традиционные базы данных (PostgreSQL, MySQL) и старые форматы памяти часто используют строковое хранение (Row-based). Данные одной строки лежат рядом: [ID: 1, Name: Ivan, Age: 30]. Это удобно для транзакций, когда нужно прочитать или обновить одну запись целиком. Но это ужасно для аналитики.

Arrow переворачивает этот принцип и организует данные по колонкам:

- Эффективность CPU: Современные процессоры работают быстрее, когда выполняют одну и ту же операцию над массивом однотипных данных (SIMD-инструкции).

- Локальность кэша: При подсчете среднего возраста процессору не нужно «перепрыгивать» через имена и ID. Он грузит в кэш только плотный массив чисел из колонки «Age».

- Предсказуемость: Формат Arrow строго специфицирован. Биты и байты лежат предсказуемо, независимо от того, на каком языке написан код.

Таким образом, архитектура Arrow заточена под максимальную пропускную способность аналитических запросов на современном железе.

Высокопроизводительная обработка данных на Python

Код курса

HPPY

Ближайшая дата курса

10 марта, 2026

Продолжительность

24 ак.часов

Стоимость обучения

76 800

Механизм работы — Магия Zero-Copy

Самое мощное преимущество Arrow, вытекающее из его стандартизованной архитектуры, — это возможность чтения без копирования (Zero-Copy Reads). Представьте, что вы хотите передать огромную таблицу из модуля на C++ в модуль на Python.

- Без Arrow: C++ создает копию данных, сериализует её. Python получает копию, десериализует и создает новые объекты. Память расходуется дважды, процессор перегружен.

- С Arrow: C++ просто передает Python адрес памяти (указатель), где лежат данные.

Поскольку оба языка «понимают» формат Arrow, Python может читать эти данные напрямую из той же области памяти, которую заполнил C++. Никакого копирования, никакого дублирования, никаких накладных расходов. Передача терабайта данных происходит практически мгновенно, так как передается только «ссылка» на данные.

Arrow vs Parquet: В чем разница?

Новички часто путают Arrow и Parquet, так как оба формата являются колоночными. Однако их цели диаметрально противоположны, и они работают в разных средах. Вот ключевые различия, которые помогают выбрать правильный инструмент

| Характеристика | Apache Parquet | Apache Arrow |

| Среда обитания | Диск (долговременное хранение). | Оперативная память (RAM). |

| Главная задача | Минимизация занимаемого места. | Максимальная скорость вычислений. |

| Формат данных | Сильно сжат и закодирован (RLE, Snappy). | «Сырой» и разжатый вид. |

| Особенность | Требует распаковки перед чтением. Это сильно нагружает CPU. | Готов к немедленным вычислениям. Никаких дополнительных затрат процессора. |

Таким образом, типичный пайплайн выглядит так: данные хранятся на диске в Parquet (для экономии места), а при чтении конвертируются в Arrow (для быстрой обработки в памяти).

Практика- работа с PyArrow

Основной библиотекой для работы с Arrow в Python является pyarrow. Она часто используется «под капотом» в Pandas, но умение работать с ней напрямую дает гибкость.

Ниже приведен пример создания базовых структур данных Arrow и их взаимодействия с Pandas, но для начала подготовим среду окружения для демонстрации:

#--- перед Демо установим необходимые пакеты в venv python3 -n venv venv source venv/bin/active pip3 install pandas numpy pyarrow ipython

Создадим скрипт demo_arrow.py

import pyarrow as pa

import pandas as pd

import numpy as np

# 1. Создание данных

data = {

'product_id': np.arange(1, 6),

'price': np.array([10.5, 20.0, 15.75, 5.0, 100.0]),

'category': ['food', 'electronics', 'food', 'home', 'electronics']

}

# 2. Конвертация Pandas -> Arrow Table

# Это происходит очень быстро

df = pd.DataFrame(data)

arrow_table = pa.Table.from_pandas(df)

print(f"Тип объекта: {type(arrow_table)}")

print(arrow_table.schema)

# 3. Обратная конвертация Arrow -> Pandas

# Благодаря Zero-Copy (где возможно) это мгновенно

df_new = arrow_table.to_pandas()

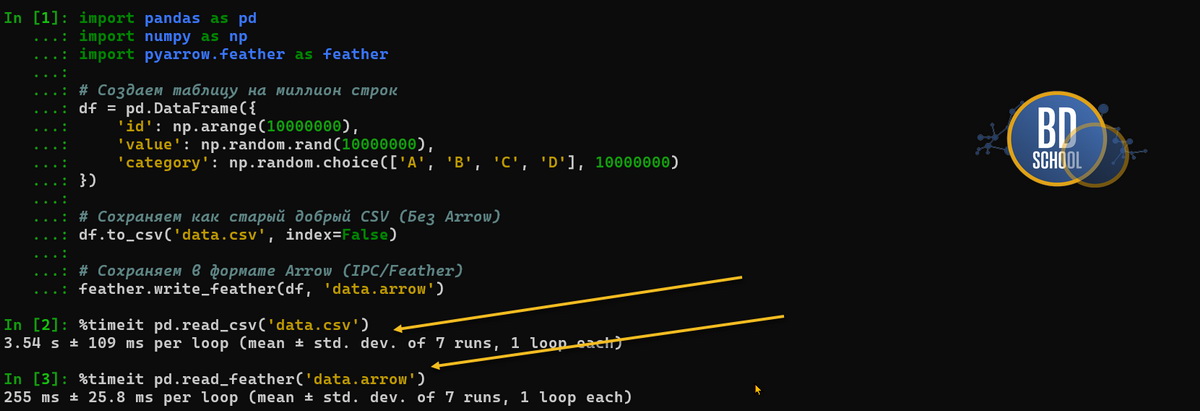

# 4. Сохранение на диск (формат Feather/IPC использует память Arrow "как есть")

import pyarrow.feather as feather

feather.write_feather(df, 'data.arrow')

По завершению работы скрипта на диске вы увидете созданный файл data.arrow файл небольшой по размеру. Поэтому чуть модифицируем пример и сделаем таблицу на 10 млн строк в формате csv и arrow и померяем производительность в ipython. ( код запроса лежит здесь ).

Как вы видите запрос на чтение файлика в формате csv занимает в много раз больше времени чем колоночная структура data.arrow, как и в использованном дисковом пространстве.

Работа напрямую с pyarrow позволяет обходить ограничения Pandas по памяти (используя memory-mapping) и эффективно работать со строгими типами данных.

Arrow в экосистеме Big Data

Настоящая сила Arrow раскрывается не в скриптах на локальной машине, а при интеграции тяжелых инструментов Big Data. Здесь технология позволяет ускорять процессы в десятки раз. Мы рассматриваем использование Apache Arrow в курсах по высокопроизводительной обработке данных на Python

Ускорение PySpark

В PySpark «узким местом» всегда было взаимодействие между исполнителем Java (JVM) и кодом Python. Раньше данные преобразовывались через медленный pickle. Включение Arrow устраняет этот барьер.

Использование Arrow в Spark критично для двух операций: конвертации toPandas() и использования Pandas UDF (User Defined Functions). Удостоверьтесь что у вас есть Java и установлен пакет pyspark — исправьте скрипт на ваши переменные

import os

# 1. Задаем точный путь к Java

# (Тебе нужно будет вписать сюда свой путь из WSL)

os.environ["JAVA_HOME"] = "/usr/lib/jvm/java-17-openjdk-amd64"

# 2. Удаляем старый системный путь Spark для избежания конфликтов

if "SPARK_HOME" in os.environ:

del os.environ["SPARK_HOME"]

# 3. ТОЛЬКО ТЕПЕРЬ импортируем инструменты PySpark

from pyspark.sql import SparkSession

import numpy as np

import pandas as pd

spark = SparkSession.builder \

.appName("ArrowExample") \

.getOrCreate()

# Активация Arrow для оптимизации передачи данных

spark.conf.set("spark.sql.execution.arrow.pyspark.enabled", "true")

# Создаем большой DataFrame

data = pd.DataFrame({'a': np.random.randn(100000), 'b': np.random.randn(100000)})

sdf = spark.createDataFrame(data)

# Операция toPandas() теперь использует Arrow

# Без настройки выше это заняло бы гораздо больше времени на больших данных

pdf_result = sdf.select("a").toPandas()

# Пример Pandas UDF (Векторизованные вычисления)

from pyspark.sql.functions import pandas_udf

@pandas_udf("double")

def vector_plus_one(series: pd.Series) -> pd.Series:

# Эта функция получает на вход не по одному числу, а сразу серию (batch)

# благодаря Arrow, что работает в 10-100 раз быстрее обычных UDF

return series + 1

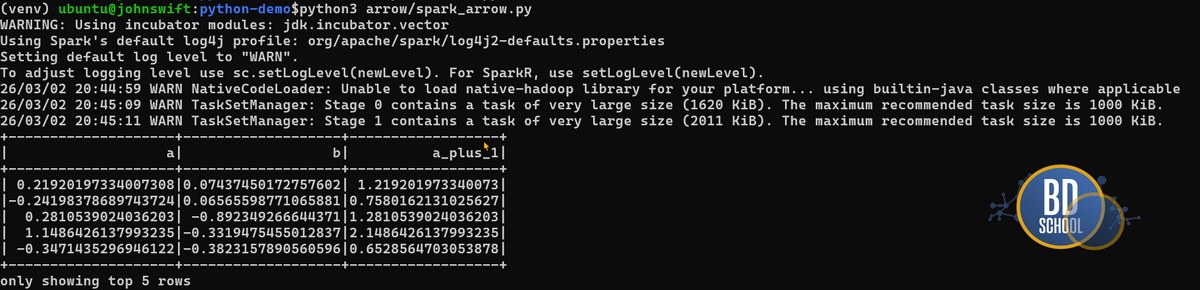

sdf.withColumn("a_plus_1", vector_plus_one(sdf["a"])).show(5)

Pandas UDF отработала безупречно. Если присмотреться к числам, колонка a_plus_1 ровно на единицу больше колонки a. И всё это рассчиталось пакетами (батчами) через In-Memory формат Arrow. Таким образом, вы своими глазами увидели весь процесс инициализации локальной сессии Spark и успешную передачу указателей памяти в Python.

Построение DWH на ClickHouse

Код курса

CLICH

Ближайшая дата курса

18 мая, 2026

Продолжительность

24 ак.часов

Стоимость обучения

76 800

Интеграция с ClickHouse

ClickHouse — это сверхбыстрая колоночная СУБД, и она «родная» для колоночных форматов. Вставка данных через стандартный SQL INSERT INTO неэффективна для миллионов строк. Использование Arrow позволяет вставлять блоки памяти напрямую.

Пример концепции быстрой вставки с использованием клиента (например, clickhouse-connect или нативного драйвера):

Не забудьте подготовить таблицу в clickhouse и установить пакет pip3 install clickhouse_connect

CREATE TABLE my_analytics_table

(

id Int64,

event_time String,

value Int64

)

ENGINE = MergeTree()

ORDER BY id;

Создаем файл скрипта для вставки данных в arrow формате arrow/clickhouse_arrow.py и запускаем на исполнение python3 arrow/clickhouse_arrow.py

import pyarrow as pa

import clickhouse_connect

# Подключение к БД

client = clickhouse_connect.get_client(host='localhost', username='default', password='')

# Подготовка таблицы Arrow

# Это может быть результат работы PySpark или чтения Parquet

data_table = pa.Table.from_pydict({

'id': [1, 2, 3],

'event_time': ['2023-10-01', '2023-10-02', '2023-10-03'],

'value': [100, 200, 150]

})

# Вставка данных напрямую в формате Arrow

# ClickHouse читает поток байтов Arrow без лишнего парсинга текста

client.insert_arrow('my_analytics_table', data_table)

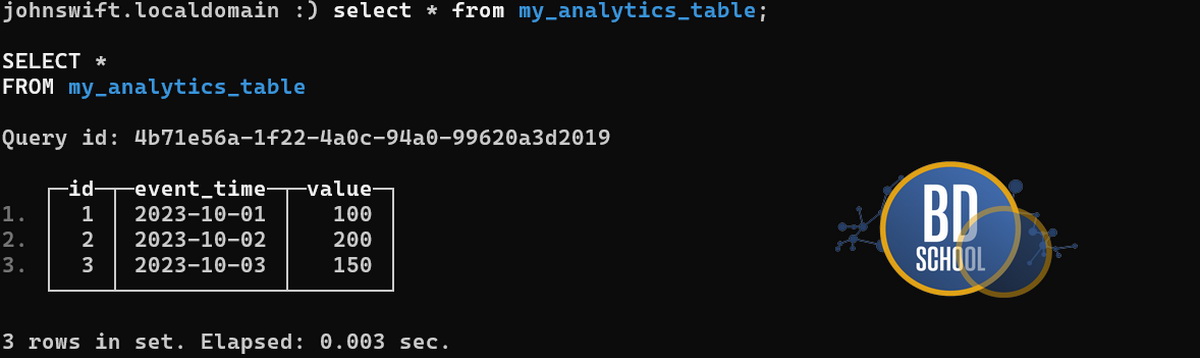

Сразу проверяем содердимое таблицы my_analytics_table

Такой подход снижает нагрузку на CPU сервера базы данных, так как ему не нужно парсить текстовые запросы INSERT.

Другие компоненты экосистемы Apache Arrow

Apache Arrow — это не только формат памяти, но и набор сопутствующих технологий, расширяющих его возможности. Ключевые проекты в рамках экосистемы Arrow:

- Arrow Flight: Фреймворк для передачи данных по сети. Заменяет устаревшие ODBC/JDBC. Позволяет передавать данные между серверами с скоростью, близкой к пропускной способности сети, без накладных расходов на сериализацию.

- Gandiva: Движок выполнения выражений, основанный на LLVM. Позволяет компилировать SQL-подобные выражения (фильтры, проекции) в машинный код, который максимально эффективно обрабатывает буферы Arrow.

- ADBC (Arrow Database Connectivity): Новый стандарт API для баз данных, который призван заменить JDBC/ODBC, изначально работая с колоночными данными.

Эти инструменты превращают Arrow из пассивного формата данных в активную платформу для высокопроизводительных вычислений.

Высокопроизводительная обработка данных на Python

Код курса

HPPY

Ближайшая дата курса

10 марта, 2026

Продолжительность

24 ак.часов

Стоимость обучения

76 800

Заключение

Apache Arrow совершил тихую революцию в мире обработки данных. Он разрушил стены между языками программирования и системами, позволив им общаться на одном языке — языке эффективной работы с памятью.

Используете ли вы Pandas, Spark, Polars, ClickHouse или строите свое ML-решение — Apache Arrow, скорее всего, уже работает у вас «под капотом», экономя часы процессорного времени. Понимание его принципов позволяет инженерам писать более эффективный код и осознанно выбирать архитектуру для своих Data-пайплайнов.

Референсные ссылки

- AArrow Official Documentation

- Wes McKinney: Apache Arow and the «10 Things I Hate About pandas»

- Dejan Simic: Understanding Arrow

- PySpark Usage Guide for Pandas with Arow

330

330